calibre User Manual¶

calibre is an e-book library manager. It can view, convert and catalog e-books in most of the major e-book formats. It can also talk to many e-book reader devices. It can go out to the Internet and fetch metadata for your books. It can download newspapers and convert them into e-books for convenient reading. It is cross platform, running on Linux, Windows and macOS.

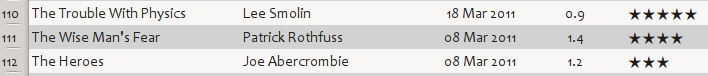

You’ve just started calibre. What do you do now? Before calibre can do anything with your e-books, it first has to know about them. Drag and drop a few e-book files into calibre, or click the “Add books” button and browse for the e-books you want to work with. Once you’ve added the books, they will show up in the main view looking something like this:

Once you’ve admired the list of books you just added to your heart’s content, you’ll probably want to read one. In order to do that you’ll have to convert the book to a format your reader understands. When first running calibre, the Welcome wizard starts and will set up calibre for your reader device. Conversion is a breeze. Just select the book you want to convert then click the “Convert books” button. Ignore all the options for now and click “OK”. The little icon in the bottom right corner will start spinning. Once it’s finished spinning, your converted book is ready. Click the “View” button to read the book.

If you want to read the book on your reader, connect the reader to the computer, wait till calibre detects it (10-20 seconds) and then click the “Send to device” button. Once the icon stops spinning again, disconnect your reader and read away! If you didn’t convert the book in the previous step, calibre will auto convert it to the format your reader device understands.

To get started with more advanced usage, you should read about The Graphical User Interface. For even more power and versatility, learn the Command Line Interface. You will find the list of Frequently Asked Questions useful as well.

If you have more questions, or want to discuss calibre with other users or ask for help with specific things, there are forums and other help resources available.

An e-book version of this User Manual is available in EPUB format, AZW3 (Kindle) format and PDF format.

Sections

- The Graphical User Interface

- Adding your favorite news website

- The E-book viewer

- E-book conversion

- Editing e-books

- The calibre Content server

- Comparing e-books

- Editing e-book metadata

- Frequently Asked Questions

- Tutorials

- The calibre:// URL scheme

- Customizing calibre

- Command Line Interface

- Setting up a calibre development environment

- Digital Rights Management (DRM)

- Glossary

The main calibre user interface¶

- The Graphical User Interface

- Actions

- Preferences

- Catalogs

- Search & sort

- The search interface

- Saving searches

- Searching the full text of all books

- Virtual libraries

- Temporarily marking books

- Guessing metadata from file names

- Book details

- Tag browser

- Cover grid

- Bookshelf view

- Cover browser

- Adding notes for authors, series, etc.

- Quickview

- Jobs

- Keyboard shortcuts

Adding your favorite news website to calibre¶

The calibre E-book viewer¶

- The E-book viewer

- Starting the E-book viewer

- Navigating around an e-book

- Highlighting text

- Read aloud

- Searching the text

- Following links using only the keyboard

- Customizing the look and feel of your reading experience

- Dictionary lookup

- Copying text and images

- Zooming in on images

- Syncing with a paper edition of the current book

- Keyboard shortcuts

- Non re-flowable content

- Designing your book to work well with the calibre E-book viewer

Customizing calibre’s e-book conversion¶

- E-book conversion

- Introduction

- Look & feel

- Page setup

- Heuristic processing

- Search & replace

- Structure detection

- Table of Contents

- Using images as chapter titles when converting HTML input documents

- Using tag attributes to supply the text for entries in the Table of Contents

- How options are set/saved for conversion

- Format specific tips

Editing e-books¶

The calibre Content server¶

Comparing e-books¶

Editing e-book metadata¶

Frequently Asked Questions¶

Tutorials¶

- Tutorials

- Adding your favorite news website

- Managing subgroups of books, for example “genre”

- XPath tutorial

- The calibre template language

- All about using regular expressions in calibre

- Writing your own plugins to extend calibre’s functionality

- Typesetting mathematics in e-books

- Creating AZW3 • EPUB • MOBI catalogs

- Virtual libraries

Customizing calibre¶

The Command Line Interface¶

Setting up a calibre development environment¶

- Setting up a calibre development environment

- Design philosophy

- Getting the code

- Windows development environment

- macOS development environment

- Linux development environment

- Having separate “normal” and “development” calibre installs on the same computer

- Debugging tips

- Using calibre in your projects

- API documentation for various parts of calibre